Data Privacy Brasil defende regulação da IA em evento na FebrabanTech

Em painel realizado na conferência FebrabanTech 2025, a Data Privacy Brasil abordou impactos socioeconômicos da Inteligência Artificial (IA) e defendeu a regulação do uso da IA pelo Congresso.

Em painel realizado na conferência FebrabanTech 2025, iniciada em São Paulo nesta terça-feira (10/06), a Data Privacy Brasil abordou impactos socioeconômicos da Inteligência Artificial (IA) e defendeu a regulação do uso da IA pelo Congresso.

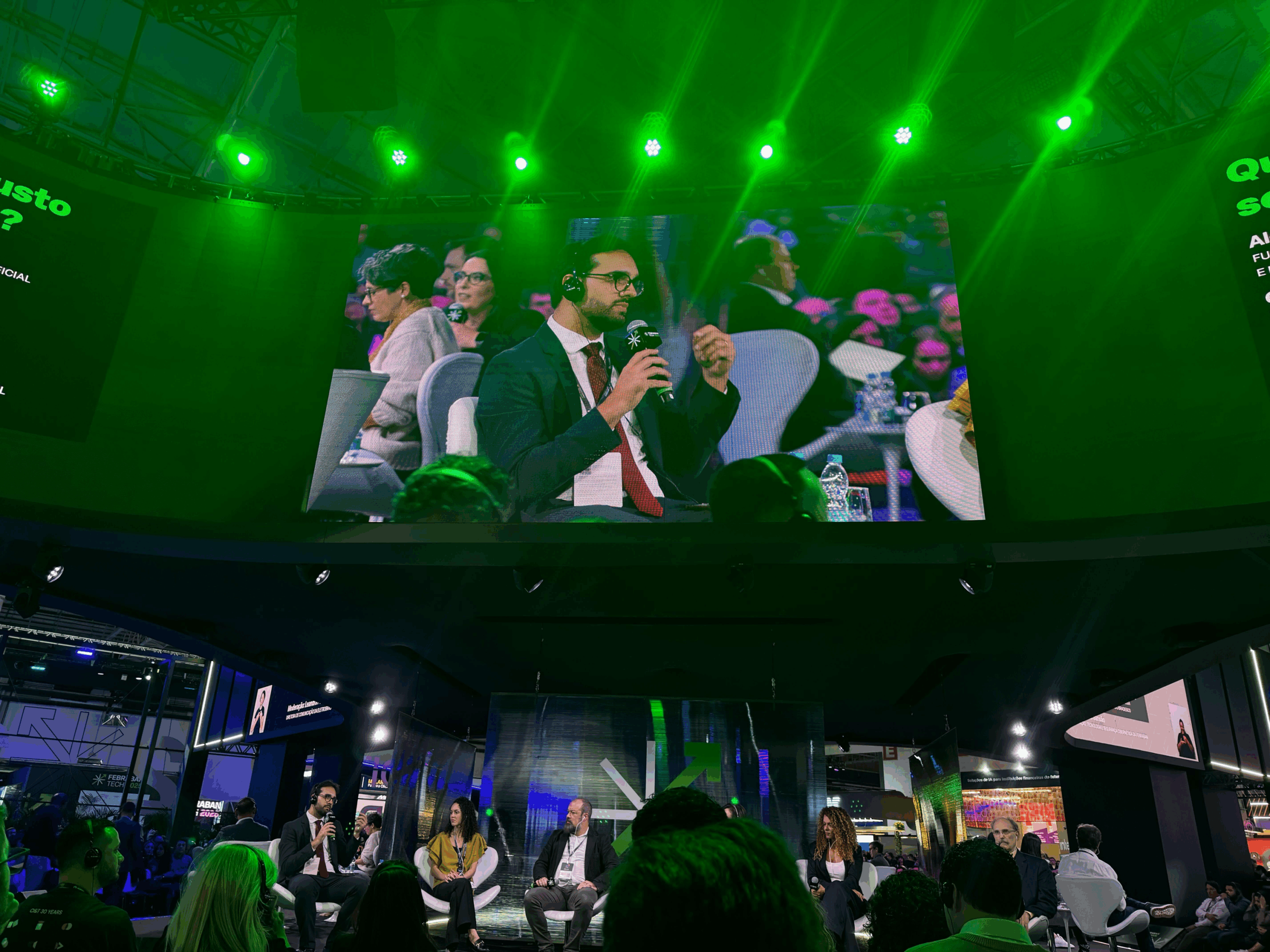

O painel “Qual é o verdadeiro custo socioeconômico da IA?” teve como tema central a pergunta: como garantir benefícios equitativos e evitar possíveis danos como a intensificação da desigualdade, o deslocamento de empregos, o comprometimento da privacidade e dos direitos do consumidor?

Mediado por Mona Dorf (diretora-adjunta de redes sociais da Febraban), o painel contou com a presença do professor Glauco Arbix (Observatório da Inovação do Instituto de Estudos Avançados da Universidade de São Paulo), Gabriela Tourinho (coordenadora de IA da BTG Pactual), Carla Lopes de Moraes (IT Senior Head na F1rst), Alexandre Del Rey (fundador e conselheiro da I2AI Associação Internacional de Inteligência Artificial) e Rafael Zanatta (codiretor da Data Privacy Brasil).

No painel, Glauco Arbix ressaltou que as escolhas institucionais presentes determinarão os efeitos distributivos das IAs, fazendo menção ao trabalho do economista Daron Acemoglu e as divergências entre as previsões de grandes consultorias empresariais e o trabalho feito por departamentos universitários.

Gabriela Tourinho e Carla Lopes ressaltaram que, apesar do “hype” em torno da produtividade da IA, há grandes oportunidades de transformações de processos produtivos internos em organizações intensivas em tecnologias, bem como oportunidades de instituição de novas relações entre pessoas e IAs no ambiente de trabalho, com o devido cuidado com a proteção dos dados e a autonomia das pessoas. “É preciso entender a funcionalidade de cada tecnologia e como ela pode colaborar de fato”, disse Lopes.

Alexandre Del Rey também reforçou a centralidade de uma estratégia nacional focada em educação e desenvolvimento de capacidades, para que as pessoas tenham proximidade com a IA e não a coloquem em um lugar místico como uma “tecnologia salvadora”. “O tema da educação em IA precisa ser pilar de uma estratégia brasileira de IA”, disse Alexandre.

Rafael Zanatta abordou o duplo fenômeno do impacto para o trabalho: de um lado, aumento das automações e eliminação de trabalhos em estágios iniciais de carreira como organização e gerenciamento de documentos, pesquisas jurídicas e revisão de códigos; do outro lado, a invisibilização de trabalhos de rotulagem de dados já existentes, como ficou notável no escândalo da empresa Builder AI, que possuía investimentos de grandes fundos e decretou falência após se provar que seus “produtos automatizados de IA” eram feitos por 700 programadores e engenheiros indianos. O mesmo escândalo ocorreu com a Amazon nas lojas “Just Walk Out”. “As cadeias de trabalho de dados tendem à terceirização no Sul Global. Precisamos dar visibilidade e produzir dados sobre que tipo de trabalho sustenta soluções de IA”, disse.

Zanatta também abordou o potencial crescimento das fraudes movidas por IA e diferentes tipos de golpes já identificados por centros de pesquisa que tendem a se intensificar com IA generativa (golpes de voz sintética para transações financeiras, golpes de imagem sintética que simulam relacionamento amoroso, golpes de automação em canais de Whatsapp para compra de criptoativos e produtos fraudulentos). “A Câmara pode olhar para o tema das fraudes e encará-lo como de alto risco diante da escala e impacto bilionário para economia popular”, afirmou.

O painel também discutiu as relações entre inovação e regulação, com enfoque na dinâmica regulatória no Brasil, que possui diversos setores econômicos regulados. Para Arbix, a inovação caminha de mãos dadas com a regulação. “O setor que mais produz inovações produtivas é o de saúde, responsável por mais de 35% das inovações em setores altamente regulados. Regulação não impede inovação”, sustentou o professor da USP.

Para Zanatta, é necessário compreender que a regulação dos usos de IA no Projeto de Lei 2338/2023 “separa o joio do trigo”, diferenciando situações muitos distintas de alto risco: “A regulação não impede a robótica industrial, a ciência em modelos de linguagem, os serviços de aprendizado em máquinas, mas mira situações muito específicas onde há riscos concretos a direitos fundamentais e potencial de dano. É algo básico que o Congresso Nacional precisa avançar com a aprovação da lei de IA em 2025”.

Confira o material de suporte da Data Privacy Brasil aqui.

Veja também

-

Data Privacy Brasil participa da VII Conferência Ibero-Americana dos Direitos da Criança no STJ

A Data Privacy Brasil, representada por Rafael Zanatta (codiretor), marcou presença na VII Conferência Ibero-Americana dos Direitos da Criança, realizada nos dias 24 e 25 de março de 2026, em Brasília. O encontro, sediado no Superior Tribunal de Justiça (STJ), representou um marco institucional: trata-se do primeiro evento oficial na história do Tribunal dedicado exclusivamente aos direitos da criança.

-

Data Privacy Brasil apresenta pesquisa sobre ilícitos de dados na 1ª Conferência de Defensoras e Defensores Públicos de Defesa do Consumidor

A Data Privacy Brasil participou da 1ª Conferência de Defensoras e Defensores Públicos de Defesa do Consumidor, realizada nos dias 17 e 18 de março de 2026 em Campo Grande (MS). Confira os destaques do evento!

-

Data Privacy Brasil lança Grupo de Estudos sobre ECA Digital

O Grupo de Estudos sobre ECA Digital da Data Privacy Brasil tem como objetivo promover um espaço de leitura qualificada, debate crítico e construção coletiva de interpretações sobre os desafios contemporâneos da proteção de direitos de crianças e adolescentes no ambiente digital. Participe!

-

A Cúpula sobre o Impacto da Inteligência Artificial da Índia em três artigos

A Data Privacy Brasil esteve presente na Cúpula sobre o Impacto da Inteligência Artificial (IA) da Índia, em Nova Délhi. Em parceria com a newsletter The Brazilian Report, elaboramos três artigos sobre a Cúpula, que reuniram expectativas e análises sobre o evento. Confira-os em um só lugar!

-

Governança da IA de baixo para cima

Nos dias 25 e 26/09/25, participamos do evento “Workers Governing Technologies Workshop”, promovido pelo grupo de pesquisa Creative Labour and Creative Futures na Universidade de Toronto no Canadá.

-

Data Privacy Brasil participa do Seminário Nacional “Prioridade Absoluta” no Supremo Tribunal Federal

Na última quinta-feira (18/09/25), aconteceu em Brasília o Seminário Nacional “Prioridade Absoluta: diálogos pela infância e adolescência no ambiente digital”, no salão nobre do Supremo Tribunal Federal. Confira nosso relato do evento. Foto: Victor Piemonte/STF

-

Entrega de subsídios do CNPD para a Política Nacional de Proteção de Dados Pessoais e da Privacidade

Diretrizes foram elaboradas em sete Grupos de Trabalho e servirão de base para a Política que será desenvolvida pela ANPD

Veja Também

-

Data Privacy Brasil participa da VII Conferência Ibero-Americana dos Direitos da Criança no STJ

A Data Privacy Brasil, representada por Rafael Zanatta (codiretor), marcou presença na VII Conferência Ibero-Americana dos Direitos da Criança, realizada nos dias 24 e 25 de março de 2026, em Brasília. O encontro, sediado no Superior Tribunal de Justiça (STJ), representou um marco institucional: trata-se do primeiro evento oficial na história do Tribunal dedicado exclusivamente aos direitos da criança.

-

Data Privacy Brasil lança Grupo de Estudos sobre ECA Digital

O Grupo de Estudos sobre ECA Digital da Data Privacy Brasil tem como objetivo promover um espaço de leitura qualificada, debate crítico e construção coletiva de interpretações sobre os desafios contemporâneos da proteção de direitos de crianças e adolescentes no ambiente digital. Participe!

-

A Cúpula sobre o Impacto da Inteligência Artificial da Índia em três artigos

A Data Privacy Brasil esteve presente na Cúpula sobre o Impacto da Inteligência Artificial (IA) da Índia, em Nova Délhi. Em parceria com a newsletter The Brazilian Report, elaboramos três artigos sobre a Cúpula, que reuniram expectativas e análises sobre o evento. Confira-os em um só lugar!

-

Governança da IA de baixo para cima

Nos dias 25 e 26/09/25, participamos do evento “Workers Governing Technologies Workshop”, promovido pelo grupo de pesquisa Creative Labour and Creative Futures na Universidade de Toronto no Canadá.

-

Data Privacy Brasil participa do Seminário Nacional “Prioridade Absoluta” no Supremo Tribunal Federal

Na última quinta-feira (18/09/25), aconteceu em Brasília o Seminário Nacional “Prioridade Absoluta: diálogos pela infância e adolescência no ambiente digital”, no salão nobre do Supremo Tribunal Federal. Confira nosso relato do evento. Foto: Victor Piemonte/STF

-

Entrega de subsídios do CNPD para a Política Nacional de Proteção de Dados Pessoais e da Privacidade

Diretrizes foram elaboradas em sete Grupos de Trabalho e servirão de base para a Política que será desenvolvida pela ANPD

-

Data Privacy Brasil participa de Fórum sobre BRICS+

No dia 28 de junho, Rafael Zanatta, codiretor da Data Privacy Brasil, participará do lançamento do Fórum de Economia Política do Direito no BRICS+, em Turim, na Itália.

-

Data Privacy Brasil contribui para formulação de evento de alto nível da Cúpula Mundial para a Sociedade da Informação

O evento, que é co-organizado pela UIT, UNESCO, PNUD, e UNCTAD, acontece em julho, e neste mês de março os stakeholders puderam enviar suas sugestões acerca do formato e do conteúdo a ser debatido, em especial à luz do processo de revisão.

-

Data Privacy Brasil discute proteção de dados pessoais na Semana do Consumidor

Em comemoração ao Dia Internacional do Consumidor, que acontece no dia 15 de março, Rafael Zanatta, codiretor da Data Privacy Brasil, foi convidado a fazer a palestra da abertura da Semana do Consumidor do Procon de Maringá.

-

Agenda de direitos digitais em 2025: os principais eventos do campo

Reunimos os principais eventos de 2025 do campo de direitos digitais para você não perder!

-

A maior DPGC da história!

Terceira edição da Data Privacy Global Conference tem recorde de público. O evento aconteceu nos dias 25 e 26 de novembro, em São Paulo.

-

Seminario Datos personales, Consumo y Competencia en Paraguay

Por invitación de la organización TEDIC, con sede en Paraguay, Data Privacy Brasil participó del seminario Datos personales, Consumo y Competencia. El seminario fue organizado como un foro de diálogo entre organizaciones de la sociedad civil de Brasil, Paraguay y Ecuador, junto con representantes del gobierno paraguayo sobre los temas de protección de datos personales y derechos del consumidor.

-

Data participa da 9ª edição do Simpósio Crianças e Adolescentes na Internet

Estão abertas as inscrições para a 9° edição do “Simpósio Crianças e Adolescentes na Internet”, que acontece no dia 23 de outubro de 2024, em São Paulo.

-

Data Privacy Brasil discute ecossistema informacional justo na Bahia

Confira a participação da Data no seminário “Algoritmos e Tomada de Decisão”, organizado pelo Núcleo de Estudos de Risco, Tecnologia e Sociedade (NERTS).

-

Seminário Inteligência Artificial, Governança e Democracia, com Rafael Zanatta

Confira a participação de Rafael Zanatta, codiretor da Data, no “Seminário Inteligência Artificial, Governança e Democracia”, sediado na Escola Nacional de Administração Pública (Enap).

-

CSOs and Governments Meeting on the Global South Digital Agenda

On September 21st and 24th, the event “Open Dialogue: Global South Alliance and Governments for an Inclusive Digital Agenda” will take place, promoted by the organizations Data Privacy Brasil, Aapti Institute, Paradigm Initiative and PCC (The New School). The event aims to provide an open conversation with diplomats about the international agenda for IPRs, AI, GDC implementation and G20 continuity.

-

Abordagens setoriais sobre infraestrutura pública digital

No painel “Infraestruturas públicas digitais em ação: análises setoriais”, realizada na manhã do dia 30, quatro especialistas foram convidados para debater problemas setoriais de IPDs: Otávio Neves (Controladoria Geral da União), Jameson Voisin (Digital Public Goods Alliance), Maria Luciano (Idec), Marcel Kremnitzer (Banco Central do Brasil). A mediação foi de Louise Karczeski da Data Privacy Brasil.

-

A infraestrutura pública digital como conceito: notas do evento “Horizontes Comuns”

A Data Privacy Brasil organizou o evento “Horizontes Comuns: o papel da infraestrutura pública digital em finanças, identidade e justiça climática”, na sede da Dataprev, em Brasília. O evento marcou o lançamento do relatório “A infraestrutura da identidade: os influxos de uma identidade digital como aplicação da IPD”.

-

Horizontes Comuns: aprofundando o debate sobre infraestrutura pública digital no Brasil

Nesta terça-feira, 30 de julho, a Data Privacy Brasil organizou o evento “Horizontes Comuns: o papel da infraestrutura pública digital em finanças, identidade e justiça climática”, na sede da Dataprev, em Brasília.

-

Data Privacy Brasil e Aliança do Sul Global participam do NETmundial+10

Entre os dias 29 e 30 de abril foi realizado em São Paulo o NETmundial+10. Retomando o evento e a declaração NETmundial de 2014, esse evento teve como foco o fortalecimento da governança global multissetorial para a Internet e tecnologias digitais, assim como mensagens voltadas aos atores globais para melhor coordenação de diferentes processos em andamento.

-

Mesa Redonda Regional da América Latina e Caribe sobre Fragmentação da Internet e Soberania Digital

A Data Privacy Brasil, com o apoio da Global Partners Digital, promove no dia 12 de março a mesa redonda “Latin American & Caribbean Regional Roundtable on Internet Fragmentation and Digital Sovereignty”.

-

Inscrições abertas para o Privacy Day Summit 2024

No dia 29 de janeiro, em comemoração ao Dia Internacional da Proteção de Dados, a Data Privacy Brasil irá realizar, em parceria com a Escola Superior de Propaganda e Marketing - ESPM, um evento especial que contará com painéis e workshops práticos voltados para o tema.

-

O fortalecimento da governança da Internet pelos países de língua portuguesa no 1° IGF Lusófono

Entre os dias 18 e 19 de setembro em São Paulo aconteceu o 1º Fórum de Governação da Internet da Comunidade Lusófona. Com uma ampla agenda de temas, o evento apresentou estudos e realizou debates com especialistas acerca do uso e da presença da língua portuguesa na Internet.

DataPrivacyBr Research | Conteúdo sob licenciamento CC BY-SA 4.0